MNIST数据集

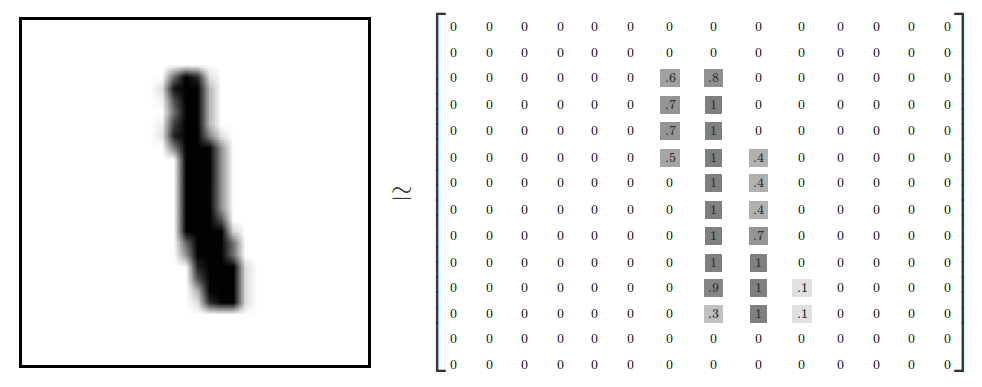

数据集中每个数据单元由一张图片和一个对应标签组成。图片包含28*28个像素点

每个像素点的值介于0-1之间,

Softmax回归

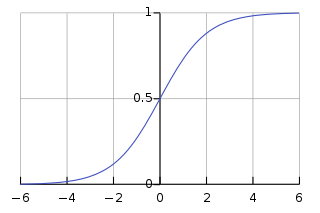

Softmax回归是Logistic回归的推广,Logistic回归用于处理二分类问题,Softmax回归可以处理多分类问题。

Logistic函数(或称为Sigmoid函数)

线性函数

代入g(z)

可推导

使用最大似然估计进行参数估计,假设所有样本独立同分布,

似然函数

对数似然函数

最大似然估计是求取最大值时的θ。可以使用梯度下降法求。

图片分类需要识别0-9,使用Softmax回归取得每个数字的概率。